Der ultimative

Microsoft 365 Copilot Guide

Mit dem Microsoft 365 Copilot Guide gelangst Du zu einer professionellen, kontrollierten und vor allem sicheren KI-Integration in deinem Unternehmen.

Lade jetzt kostenlos meinen ultimativen Copilot-Leitfaden herunter.

Einstieg in Microsoft 365 Copilot

Copilot konform einrichten

Da Microsoft 365 Copilot als Add-On-Lizenz verfügbar ist, kann diese KI-Lösung konform und effizient in deiner Microsoft 365 Umgebung bereitgestellt werden.

Zentrale Verwaltung aller Copilot-Funktionen

Richtlinien, Einstellungen und die Aktivierung von Copilot-Features werden zentral verwaltet - erfahre in diesem Guide wie Du vorgehen musst.

Microsoft 365 Copilot Sicherheit

Durch Tools wie die Sensitivity Labels und Conditional Access Policies kann Microsoft 365 Copilot vor allem sicher in Dein Unternehmen eingeführt werden. Sind Dir alle Schritte bekannt?

Die KI-gestützte Produktivitätslösung Microsoft 365 Copilot bietet einen umfassenden Funktionsumfang. In diesem Guide gebe ich sowohl Einsteigern als auch Profis einen tiefen Einblick in die Funktionsweise und den sicheren Einsatz von Microsoft 365 Copilot.

Microsoft 365 Copilot sicher administrieren - mein Livestream mit Golem!

Sie sehen gerade einen Platzhalterinhalt von Standard. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf den Button unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Weitere InformationenMicrosoft Copilot Schulungen

Mit einer professionellen Microsoft 365 Copilot Schulung von mir können Projekte erfolgreich im Do-it-Yourself-Modus umgesetzt werden.

Microsoft Copilot Beratung

Brauchst du Beratung und Support bei der Einführung, Einrichtung und Feinabstimmung von Microsoft 365 Copilot in deinem Unternehmen? Mit meinem Wissen und meiner Erfahrung stehe ich Dir gern jederzeit zur Seite!

Überblick zu Copilot

Der Funktionsumfang und die generelle Arbeitsweise werden in den folgenden Artikeln zu Microsoft 365 Copilot gezeigt. Ich liefer dir einen Schnellüberblick von smarten Prompts bis zur tiefergehenden Integration.

Sie sehen gerade einen Platzhalterinhalt von Standard. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf den Button unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Weitere InformationenSie sehen gerade einen Platzhalterinhalt von Standard. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf den Button unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

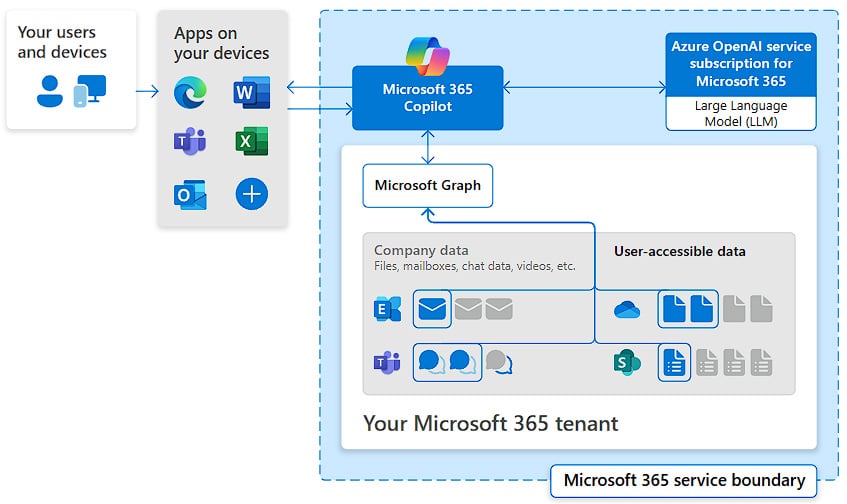

Weitere InformationenMicrosoft 365 Copilot Architektur

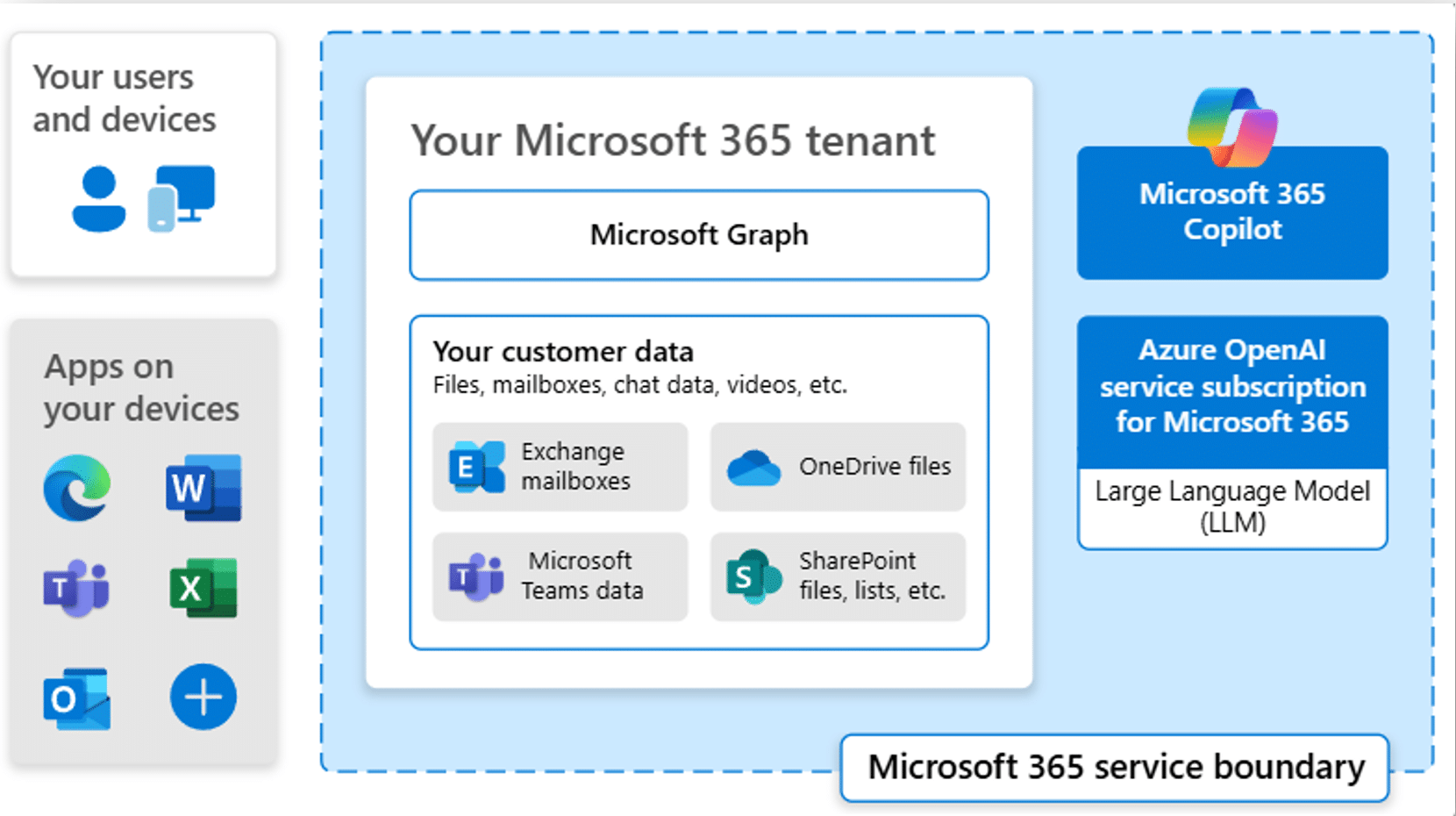

Microsoft 365 Copilot nutzt Daten aus dem Microsoft Graph, OneDrive und SharePoint, verarbeitet sie innerhalb deutscher Rechenzentren und liefert Antworten über das sogenannte Grounding und den semantischen Index.

Microsoft 365 Copilot bewegt sich stehts innerhalb der Microsoft 365 Service Boundary. Die Service Boundary beschreibt, in welchen Rechenzentren und Speicherorten wir unterwegs sein werden mit den verarbeiteten Daten.

Bei einem deutschen Microsoft 365 Tenant bedeutet dies konkrekt: Die Datenbasis, das sogenannte Grounding, auf der Microsoft 365 Copilot alle Informationen stützt, wird primär über den Microsoft Graph in den Rechenzentren in Frankfurt und bei Berlin bezogen.

Grounding mit Microsoft Graph

Microsoft Graph spielt eine zentrale, wenngleich indirekte Rolle beim Grounding. Copilot sammelt über Graph relevante Informationen aus den verschiedenen Microsoft 365 Onlinediensten. Dazu gehören u.a. das primäre Exchange-Postfach, sowie auch andere Datenquellen, wie SharePoint Online, OneDrive und Microsoft Teams. Die dort erhaltenen Informationen bilden die Grundlage für die Antworten und Aktionen von Copilot - die Informationen können mit Webergebnissen erweitert werden.

Hinweis: Graph selbst speichert keine Daten, sondern ermöglicht lediglich den Zugriff.

Wusstest du das? Microsoft 365 Copilot greift nicht auf die öffentlichen OpenAI-Dienste zu, sondern nutzt einen speziell angepassten Azure OpenAI Service innerhalb deiner Microsoft 365 Service Boundary. Microsoft 365 Copilot indexiert alle 8 Stunden deine Berechtigungen neu - änderst du also Zugriffsrechte, kann es bis zu 8 Stunden dauern, bis Copilot das checkt. Die Indexierung läuft immer zur UTC-Zeit null, also um 8 Uhr, 16 Uhr und Mitternacht.

Klassifizierung & Conditional Access

Die korrekte Dokumentenklassifizierung und ein klar definierter Zugriff via Conditional Access nersetzlich bei der Nutzung vom Microsoft 365 Copilot.

Wir können Datenklassifizierungsstufen auf Dokumentebene anwenden, um die Verarbeitung sensibler Informationen zu steuern. Copilot nutzt diese Klassifizierungen, um innerhalb unserer Anwendungen – sei es bei der Zusammenfassung von Meetings, der Erstellung von Präsentationen oder der Bearbeitung von Office-Dokumenten – die richtigen Informationen an den User bereitzustellen. Eine korrekt angewendete Klassifizierung verhindert, dass einem User für ihn nicht vorgesehene Inhalte/Dokumente angezeigt werden.

Ein weiterer wichtiger Punkt ist die Nutzung von Copilot auf (mobilen) Endgeräten. Hier müssen wir entscheiden, ob wir Mitarbeitern die Nutzung auf nicht verwalteten Geräten gestatten. Die Ausgabe von Copilot, die aus unserer definierten Service Boundary stammt, kann sensible Informationen enthalten, die auf nicht verwalteten Geräten ein Sicherheitsrisiko darstellen könnten.

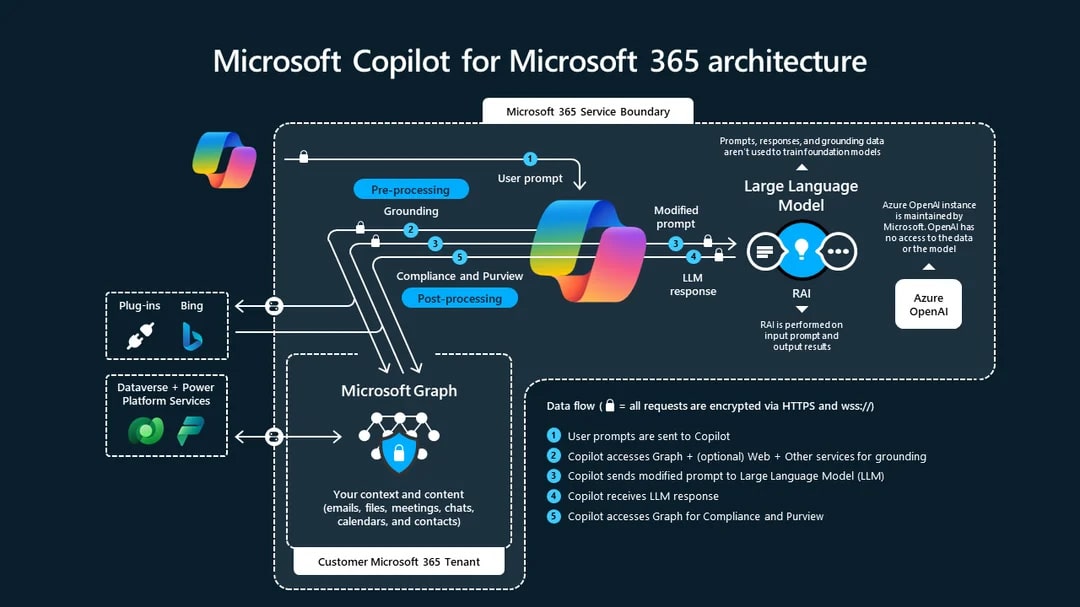

Prompt-Verarbeitung & Architektur

Der Prozess des Abfragens und Erstellens von Prompts (siehe Grafik weiter unten) folgt einem konsistenten Aufbau, der in der untenstehenden Grafik sehr deutlich dargestellt ist.

Data-at-Rest vs. Data-in-Transit

Wir nutzen nicht die öffentlich zugänglichen OpenAI-Dienste, sondern unseren speziell seitens Microsoft bereitgestellten Azure OpenAI-Dienst. Das bedeutet, dass keine Kundendaten außerhalb der Heimatregion des Benutzers gespeichert werden. Deswegen ist es wichtig, grundlegend zwischen Data-in-Transit und Data-at-Rest zu unterscheiden.

Data-at-Rest (ruhende Daten): Werden mit einer 256-Bit-AES-Splitting-Verschlüsselung geschützt und verbleiben ausschließlich in unseren Rechenzentren.

Data-in-Transit (Daten während der Übertragung): Anfragen dürfen auch außerhalb unserer eigenen Rechenzentren zum Transport verarbeitet werden.

Der Copilot indiziert zunächst alle zugänglichen Daten in unserem Tenant. Microsoft weist darauf hin, dass bei Spitzenlasten, also wenn nicht genügend Leistung zur Verfügung steht, Copilot eine Datenverarbeitung (nicht Speicherung!) temporär außerhalb unseres (Heimats-)Tenants durchführen kann.

Nach Deutschland kommt der europäische Tenant mit seinen Rechenzentren in Amsterdam und Dublin. Wir als User erhalten dazu keine Benachrichtigung zur externen Verarbeitung. Das bedeutet, dass wir keine Garantie dafür bekommen, dass eine Prompt-Abfrage oder die Bearbeitung durch das Large Language Model ausschließlich innerhalb unserer eigenen Rechenzentren erfolgt.

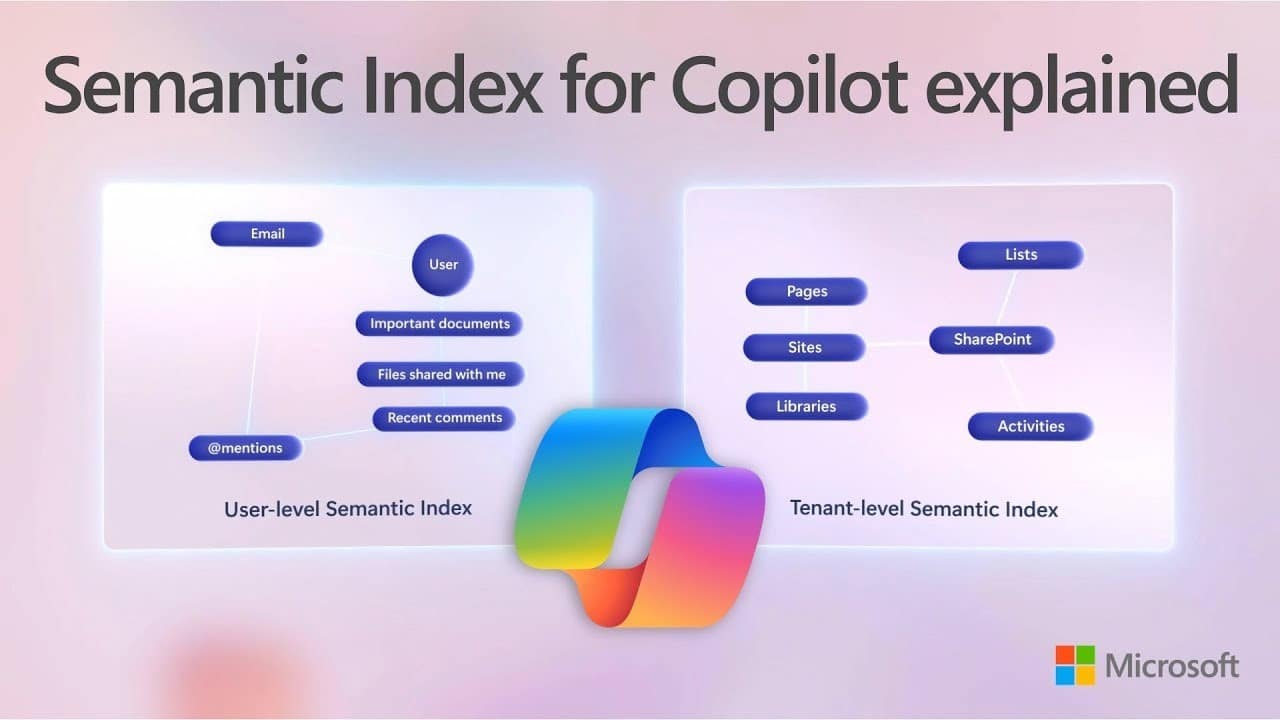

Struktur des semantischen Index

Der Semantische Index für Microsoft 365 Copilot ist eine Funktion, die die Beziehungen zwischen verschiedenen Inhalten und Konzepten innerhalb eines Tenant kartiert.

Microsoft 365 Copilot analysiert durch den Semantischen Index Daten wie E-Mails, Dokumente und andere Dateien im Microsoft Graph, um Verbindungen und Zusammenhänge zu erkennen.

Der semantische Index, der für Copilot verwendet wird, durchsucht unseren gesamten Tenant und greift auf alle relevanten Daten zu. Wir müssen daher unsere Datenstruktur und Zugriffsrechte überprüfen und bei Bedarf anpassen, um zu verhindern, dass Nutzer nicht auf unbefugte Informationen und Inhalte zugreifen können.

Um zu verstehen, wie der semantische Index funktioniert, ist es wichtig, seine Unterteilung zu betrachten: den User-Level-Semantic-Index und den Tenant-Level-Semantic-Index.

Tenant-Level Semantischer Index

Der Tenant-Level Index ist das Herzstück von Copilots Datenverarbeitung. Er durchsucht deinen gesamten Tenant und erfasst dabei SharePoint-Seiten, Webparts, Sites, Bibliotheken, Listen und sogar Microsoft Lists. Wichtig zu wissen: OneDrive, Teams und Microsoft 365 Gruppen bauen alle auf SharePoint auf und werden ebenfalls indexiert.

Ein häufiges Problem ist, dass Abteilungsdateien fälschlicherweise in persönlichen OneDrives landen statt in gemeinsamen SharePoint-Bereichen.

User-Level Semantischer Index

Der User-Level Index ist "deine persönliche Copilot-Datenbasis". Er umfasst alle Dokumente, die du selbst abgelegt hast, geteilte Inhalte (direkt oder über Gruppen), Dokumente in denen du erwähnt wurdest und sogar Kommentare in gemeinsam bearbeiteten Dateien.

Cross-Tenant-Synchronisierung und Gastzugriffe

Copilot greift niemals auf Daten aus Cross-Tenant-Synchronisierungen oder externe Gastzugriffe zu. Diese Inhalte werden weder indexiert noch in Ergebnissen angezeigt - du musst dir also keine Sorgen um externe Datenquellen machen.

Trotzdem ist die Überprüfung von Gastzugriffen wichtig, denn diese bleiben oft bestehen, selbst wenn Berechtigungen geändert oder überhaupt nicht mehr benötigt werden. Viele Unternehmen haben einen unübersichtlichen Wildwuchs an Gastkonten, die niemand mehr braucht. Die Lösung dafür sind Access Reviews mit automatischen Ablaufzeiten - alternativ, sofern es Eure Lizenz nicht hergibt, kann man auch via GraphAPI das 'Last Login Date' validieren. So stellst du sicher, dass nur aktive externe Partner Zugriff haben.

Synchronisierung und Indexierung von Berechtigungen

Die Berechtigungssynchronisierung ist Copilots Achillesferse: Microsoft 365 führt nur alle 8 Stunden eine vollständige Indexierung durch. Änderst du Zugriffsrechte um 9 Uhr morgens, sieht Copilot das erst um 16 Uhr - nicht gerade optimal für dynamische Umgebungen. Die Synchronisierung läuft immer zu festen UTC-Zeiten: 0 Uhr, 8 Uhr und 16 Uhr. Das betrifft alle Berechtigungsänderungen in SharePoint, Teams und OneDrive.

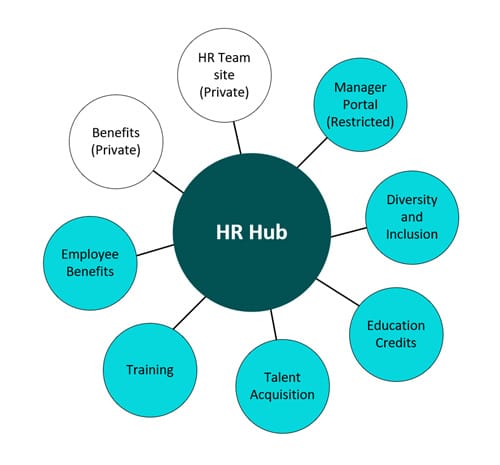

Copilot und SharePoint-Daten zum Antworten

Microsoft 365 Copilot greift neben Office-Dokumenten auch auf SharePoint-Daten für die Beantwortung von Fragen zu.

Erinnern wir uns nochmal daran: Es werden standardmäßig alle Inhalte innerhalb unseres Microsoft 365 Tenants indexiert - wollen wir dies einschränken, so müssen wir auf die Restricted SharePoint Search zurück greifen.

Die Zugriffsvalidierung durch Microsoft 365 Copilot ist dabei entscheidend. Technisch gesehen sollte Copilot nur auf Informationen zugreifen, für die der Benutzer berechtigt ist. Dies betrifft Dateien in OneDrive (eigene und geteilte), Exchange-Postfächer, Chat-Nachrichten (ohne gelöschte) und SharePoint-Inhalte.

Änderungen nachvollziehen und SharePoint-Aktivitäten überwachen

Mit der erweiterten Verwaltung im SharePoint Online behältst du den Überblick, wer wann was in SharePoint geändert hat - essentiell für eine sichere Copilot-Umgebung und zugleich die Möglichkeit eine erste IST-Aufnahme der aktuellen Konfiguration und des Datenbestandes aufzunehmen.

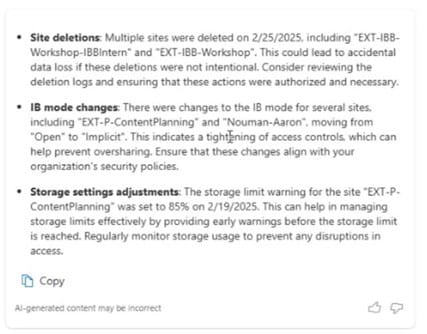

Überwachung durchgeführter Änderungen

Im Change History Report siehst du alle administrativen Änderungen - von gelöschten Seiten bis zu angepassten Freigabeeinstellungen. Der Bericht zeigt dir, welche Administratorrollen aktiv waren und welche kritischen Änderungen vorgenommen wurden.

Unterstützung durch AI Insights

AI Insights meldet dir relevante Ereignisse wie gelöschte Seiten oder größere Strukturänderungen. Die KI erkennt Muster und weist dich proaktiv auf ungewöhnliche Aktivitäten hin, zum Beispiel wenn plötzlich viele Freigabeeinstellungen geändert werden.

Regelmäßige Kontrolle der Nutzeraktivität

Nicht jeder Hinweis erfordert sofortiges Handeln, aber regelmäßige Checks sind Gold wert. Die Berichte zeigen dir, wie intensiv SharePoint genutzt wird und ob bestimmte Entwicklungen Aufmerksamkeit brauchen - damit Copilot nur auf saubere Daten zugreift.

Konfigurationen im Compliance-Portal

Das Microsoft Purview Compliance Portal ist quasi die Schaltzentrale für unsere "Microsoft 365 Copilots Datensicherheit". Hier legst du fest, welche Daten Copilot verarbeiten darf und welche tabu sind. Von Information Barriers über Sensitivity Labels bis zu eDiscovery - das Portal bietet alle Tools, um Copilot DSGVO-nah (nicht zwingend konform!) zu betreiben.

Hinweis: Die im Purview Compliance Portal getroffenen Einstellungen greifen direkt in Copilots Antwortverhalten ein. Wenn du zum Beispiel bestimmte Dokumente mit Sensitivity Labels versiehst, kann Copilot diese je nach Konfiguration komplett ignorieren oder nur für bestimmte Nutzergruppen zugänglich machen.

Information Barriers in Microsoft Purview

Information Barriers segmentieren deine Organisation in kommunikativ getrennte Bereiche - ursprünglich für Banken entwickelt, wo Broker und Analysten nicht kommunizieren dürfen. Die Barrieren blockieren Teams-Chats, E-Mails und sogar Copilot-Prompts zwischen definierten Gruppen.

Granulare Steuerung mit Sensitivity Labels

Du kannst Dokumente klassifizieren (Öffentlich, Intern, Vertraulich, Streng Vertraulich) und für jede Stufe definieren, wer Zugriff hat. Copilot respektiert diese Labels - hat ein Dokument ein Label, das dem User keinen Lesezugriff gewährt, taucht es auch nicht in Copilot-Ergebnissen auf. Du kannst sogar visuelle Markierungen wie Wasserzeichen hinzufügen oder Dokumente verschlüsseln.

Schwellwerte richtig definieren

Bei automatischen Labels musst du die Balance finden: Zu niedrige Schwellwerte 'nerven' User mit ständigen Label-Vorschlägen, zu hohe verpassen wichtige Dokumente. Beispiel: Soll Copilot ein "Vertraulich"-Label vorschlagen, wenn eine einzelne Kreditkartennummer im Dokument steht oder erst ab 50? Die Kunst liegt darin, Schwellwerte so zu setzen, dass sie Sicherheit bieten ohne den Workflow zu stören. Tipp: Starte mit manuellen Labels, sammle Erfahrungen und aktiviere dann schrittweise die Automatisierung mit angepassten Schwellwerten.

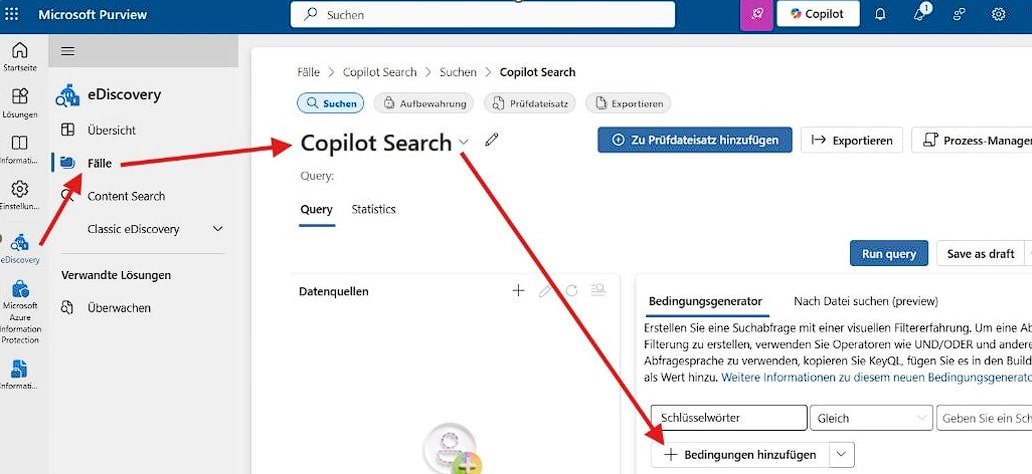

Einsatz von eDiscovery zur Analyse digitaler Aktivitäten

Wenn es darum geht, ein umfassendes digitales Abbild von Benutzeraktivitäten zu erstellen – z. B. zur Beweissicherung oder Dokumentation – bietet sich die Nutzung von eDiscovery in Microsoft 365 an.

Dieses Werkzeug ermöglicht die Suche und Archivierung von:

- E-Mails

- Chatnachrichten

- Dateien

- Teams-Kommunikation

- Microsoft 365 Copilot Prompts (!)

Copilot speichert alle Nutzeranfragen (Prompts) und die generierten Antworten in den Exchange-Postfächern der User - das bedeutet, du kannst über eDiscovery sogar nachvollziehen, was Mitarbeiter Copilot gefragt haben und welche Antworten sie bekommen haben. Ein mächtiges Tool für Compliance, aber auch ein heißes Eisen beim Thema Mitarbeiterüberwachung!

Auch im Kontext von Microsoft Copilot lässt sich eDiscovery einsetzen.

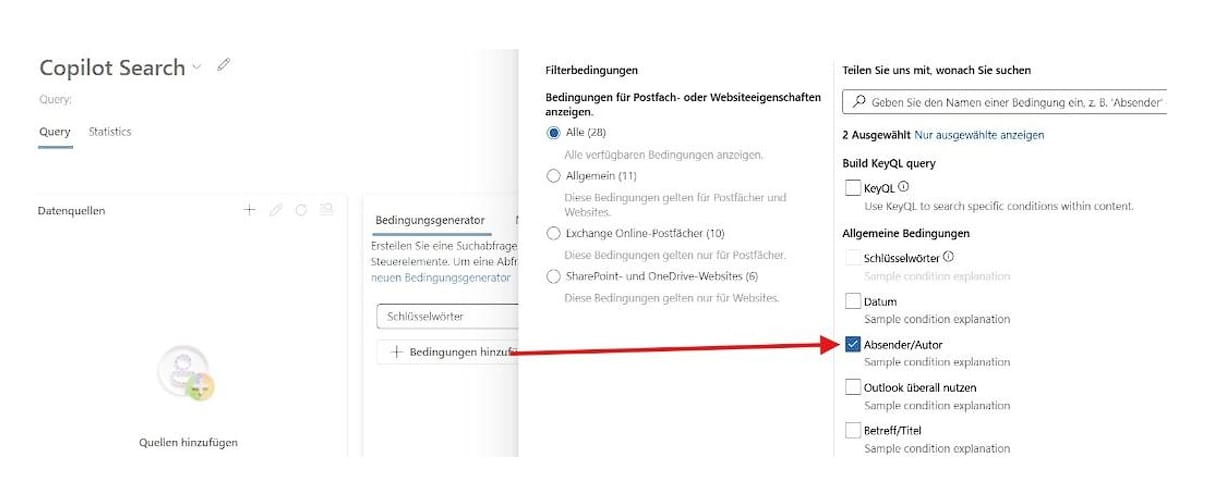

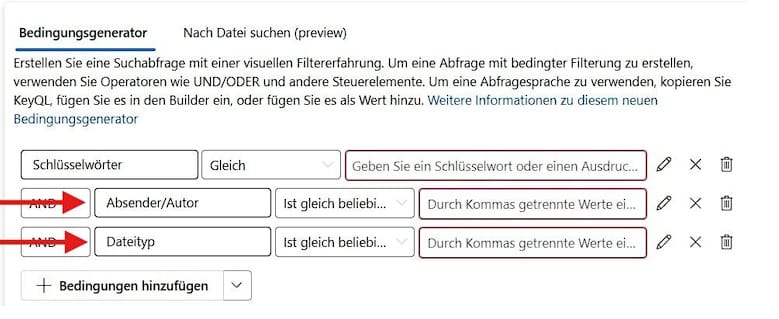

Pfad: purview.microsoft.com → eDiscovery → Fälle

Wir wählen nun einen beliebigen Fall und klicken uns durch zu Bedingungen hinzufügen.

Über Copilot Search können wir gezielt nach Inhalten oder Aktionen innerhalb des Copilot-Kontextes suchen – z. B. anhand von Parametern wie Autor, Absender oder Dateityp.

Pfad: purview.microsoft.com → Lösungen → Überwachen

Ergänzend zur eDiscovery bietet die Funktion Überwachen (Auditing im Englischen) in Microsoft Purview eine sehr feingranulare Nachverfolgung von Benutzeraktivitäten – auf Klick-Ebene.

Hier können wir nachvollziehen,

- welche Dateien geöffnet, geändert oder gelöscht wurden,

- ob und wann Nachrichten versendet oder weitergeleitet wurden,

- und spezifisch für Copilot: Welche Prompts eingegeben wurden.

Während IT-Abteilungen diese Tools gern zur Absicherung oder Fehleranalyse einsetzen würden, verweigern Datenschützer und Betriebsräte mitunter die Freigabe. Daher ist eine frühzeitige Abstimmung mit den zuständigen Gremien (z. B. Datenschutzbeauftragten oder dem Betriebsrat) essenziell, bevor solche Lösungen implementiert werden. Glaubt mir, hierauf ist schon viel Lebenszeit draufgegangen ...

Damit die DSGVO-Compliance und Microsoft Security Ihres Unternehmens keine Glückssache ist.

Restricted SharePoint Search & Nachrichtencenter

Zur Vorbereitung von Microsoft 365 Copilot empfiehlt es sich, verschiedene Richtlinien im Admin Center zu definieren, um Zugriff, Sicherheit und Datenindexierung gezielt zu steuern.

SharePoint Search: Suchergebnisse gezielt einschränken

Die Restricted SharePoint Search ist eine sinnvolle Funktion, um die Indexierung und Darstellung von Inhalten in Microsoft 365 Copilot gezielt zu steuern. Sie definiert, welche SharePoint-Seiten in die Suche einbezogen werden sollen – alles andere bleibt außen vor.

Wenn Sie beispielsweise 20 spezifische Seiten (es können in Summe bis zu 100 SharePoint-Seiten sein) für die Indexierung freigeben, werden ausschließlich diese Inhalte von Copilot berücksichtigt. Seiten, die nicht in der Freigabeliste enthalten sind, werden weder indexiert noch in Suchergebnissen vorgeschlagen. Dies geht via Shell (siehe weiter unten) oder auch über das SharePoint Online Admincenter.

Diese Funktion ist besonders relevant für Organisationen, die Copilot bereits nutzen, aber nachträglich die Kontrolle über dessen Datenbasis stärken möchten – etwa, wenn nicht klar ist, welche Inhalte bislang verarbeitet wurden. Hier gilt: Better Safe than Sorry!

Copilot zeigt dann nur noch Inhalte an, für die Benutzer entweder explizit berechtigt sind oder die Teil der freigegebenen Seitenliste sind. Es entfallen automatisch Vorschläge zu Inhalten, auf die kein gezielter Zugriff besteht.

Außerdem erhält der Benutzer einen klaren Hinweis, dass eine eingeschränkte Suche aktiv ist und ihm nicht alle Ergebnisse angezeigt werden.

Hinweis an dieser Stelle: Wenn eine SharePoint Online Hub-Site besteht, die entsprechend verschiedene Unterseiten hat, so wird nur die Hub-Site als Eintrag gewertet und nicht jeden darin enthaltene Unterseite.

Zur Nutzung dieser Funktion ist keine zusätzliche Lizenz erforderlich.

Bestehende Berechtigungen bleiben unangetastet, aber die Sichtbarkeit über die Suche wird entsprechend begrenzt.

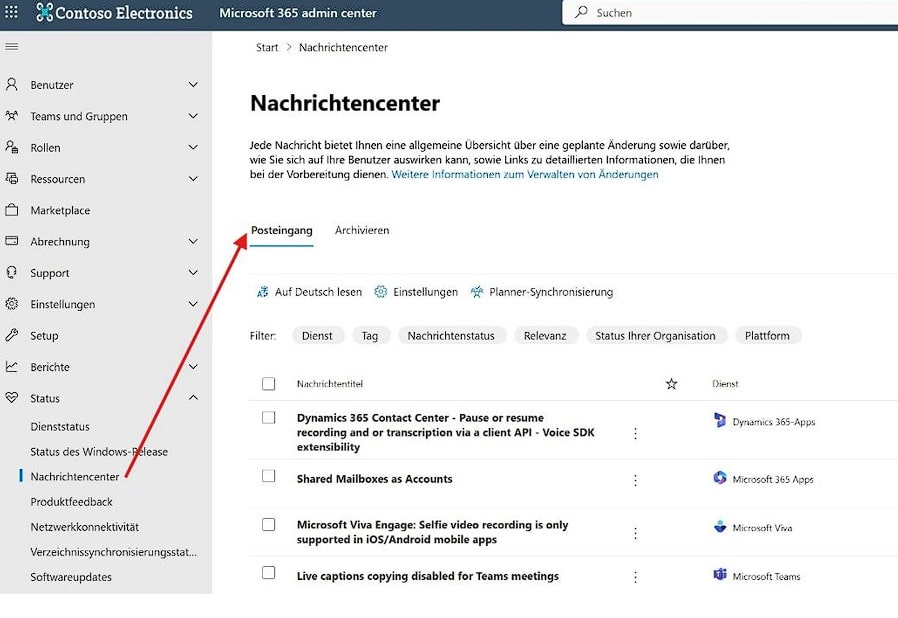

Nutzung des Nachrichtencenters für Microsoft 365 Copilot Updates

Pfad: admin.microsoft.com → Status → Nachrichtencenter

Über das Nachrichtencenter können wir uns zentral über alle aktuellen Microsoft 365 Updates informieren lassen. Die Inhalte stammen direkt von Microsoft – nicht von Drittanbietern – und bieten somit eine verlässliche Quelle für Produktneuigkeiten, Funktionsänderungen und sicherheitsrelevante Hinweise.

Wir können uns zudem E-Mail-Benachrichtigungen aus dem Nachrichtencenter einrichten. Auch wenn das nicht den regelmäßigen Blick in das Portal ersetzt, hilft es dabei, relevante Änderungen frühzeitig mitzubekommen.

Wenn es darum geht, in Microsoft 365 stets auf dem neuesten Stand zu bleiben, ist das Nachrichtencenter Deine zentrale Anlaufstelle.

Taxonomie und standardisierte Dokumentenbenennung

Die Qualität der Copilot-Erfahrung hängt entscheidend von den in Microsoft 365 indexierten Datenquellen ab. Hierbei ergibt sich ein wichtiger Aspekt, der in der Praxis oft eine Herausforderung darstellt: der Aufbau einer Taxonomie. Es ist wahrscheinlich, dass die IT-Abteilung hierbei nicht allein agieren kann.

Eine klare Taxonomie und standardisierte Dokumentenbenennung sind entscheidend für effizientes Datenmanagement. Sogenannte Data Stewards oder Data Guards spielen eine wichtige Rolle hierbei.

Der Aufbau einer Taxonomie beinhaltet die Verwendung von Tags in Teams, Hashtags in Chats und die Bearbeitung von Dokumenteigenschaften. Dazu gehören Informationen wie Autor, Dokumentkategorie (z. B. Verkaufs-, Finanz- oder Vertragsdokument) und die Einhaltung einer einheitlichen Namenskonvention.

Im Unternehmen sollten nicht nur die Admins, sondern eigene “Data Stewards” in die Dokumentenverwaltung innerhalb von Teams- und SharePoint-Sites eingebunden werdne, um sicherzustellen, dass die Namenskonventionen schrittweise aufgebaut und auch dauerhaft eingehalten werden.

Tipp: Anstatt Dokumente als "Version 4, 5, 6, 7, 8" zu benennen, empfiehlt es sich, eine standardisierte Namenskonvention zu verwenden, die idealerweise vom Allgemeinen zum Spezifischen übergeht.

Weitere Hinweise und erforderliche Einstellungen in den Microsoft 365 Admin Centern

Das Microsoft 365 Admin Center navigiert durch SharePoint-Einstellungen, Berichte und Self-Service. Die Konfiguration von Freigaben, Installationsrisiken, Speicherlimits und Zugriffsmanagement - in Summe alles Einstellungen die auch für unsere Microsoft 365 Copilot Bereitstellung von Bedeutung sind.

Microsoft 365 Gruppen

Pfad: admin.microsoft.com → Teams und Gruppen → Aktive Teams und Gruppen

Eine Microsoft 365 Gruppe umfasst oftmals ein Team aus Microsoft Teams heraus (wobei dies nicht zwingend eine Voraussetzung sein muss!), eine E-Mail-Adresse und weitere Komponenten, wie eine SharePoint Online Bibliothek.

Bei der Erstellung eines Teams wird technisch gesehen im Backend eine Microsoft 365 Gruppe aufgebaut, während im Frontend - somit das für den User ersichtliche - ein Teams genutzt wird.

Die Microsoft 365 Gruppe ist eine zentrale Komponente, die verschiedene Dienste integriert. Dazu gehören SharePoint-Speicher, OneDrive-Aufnahmeordner, Planner-Aufgaben, Kommentare, freigegebene Postfächer, Teams-Inhalte, SharePoint-Inhalte und Power BI.

Es ist wichtig, die Konfiguration der Teams- und Microsoft 365 Gruppenanlage zu überprüfen. Eine Microsoft 365 Gruppe kann ohne Teams angelegt werden, ein Teams jedoch nicht ohne Microsoft 365 Gruppe.

Hinweis: Ihr solltet über ein automatisiertes Ablaufdatum für Eure Microsoft 365 Gruppen (somit auch für Eure Teams) nachdenken, um nicht mehr erforderliche Teams und Gruppen nach einem gewissen Zeitraum zu löschen. Dies könnt Ihr in den Gruppeneinstellungen im Entra ID konfigurieren.

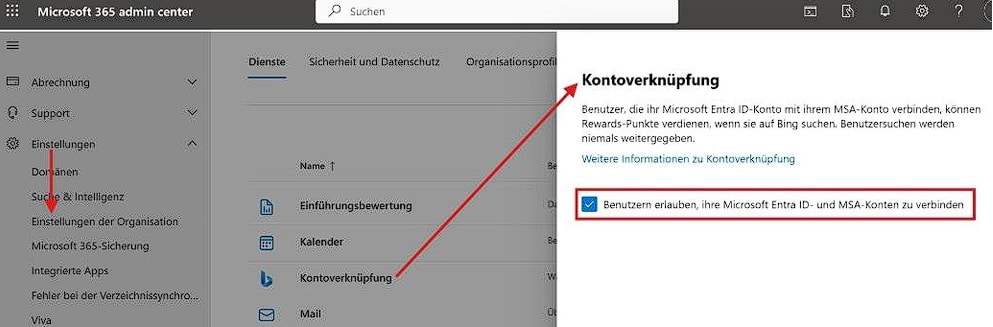

Die Kontoverknüpfung in den Organisationseinstellungen

Pfad: admin.microsoft.com → Einstellungen → Einstellungen der Organisation → Kontoverknüpfung

Die Kontoverknüpfung ermöglicht die Verknüpfung von Microsoft Entra ID-Konten mit MSA-Konten, um bei Bing-Suchen Belohnungspunkte zu sammeln. Hierbei handelt es sich nicht um eine reine Sicherheitskonfiguration, sondern um ein Compliance-Thema. Der Bing-Suchdienst ist in Microsoft 365 Copilot integriert.

Tipp: Trennen zwischen geschäftlichen und privaten Konten. Die geschäftliche Nutzung von Copilot sollte ausschließlich mit geschäftlichen Konten erfolgen, die private Nutzung von Bing oder Copilot entsprechend auch nur mit privaten Konten.

Durch die Verknüpfung kann der Bing-Suchdienst Metadaten auswerten, um zwischen privaten und geschäftlichen Suchen zu unterscheiden. Zu diesen Metadaten gehören Suchinhalte, IP-Adressen und Browserversionen. Die Daten werden zur Verbesserung der Bing-Suchergebnisse verwendet, die auch in Microsoft 365 Copilot angezeigt werden.

Empfehlung: Falls Kontoverknüpfung aktiviert ist, deaktiviere diese.. Das hat in der Regel keine Auswirkungen auf die meisten Benutzer. Benutzer, die zuvor eine Verknüpfung hatten, werden jedoch möglicherweise aufgefordert, sich mit einem geschäftlichen Konto anzumelden, um den geschäftlichen Bereich nutzen zu können.

Im Bereich Einstellungen der Organisation gibt es weitere Konfigurationsoptionen, die im Rahmen einer Tenant-Härtung überprüft werden sollten. Für Copilot sind u.a. zwei Optionen relevant:

- Berichte & Pseudonymisierung

- Self-Service-Testversionen und -Käufe

Berichte & Pseudonymisierung

Wenn du in M365 Admin Center → Einstellungen der Organisation → Berichte den Schalter aktivierst, zeigt SharePoint- und Copilot-Reports keine echten Nutzernamen mehr, sondern nur noch kryptische Buchstaben-Zahlen-Codes. Das ist keine Anonymisierung, sondern Pseudonymisierung – wichtig für eine DSGVO-nahe Konfiguration.

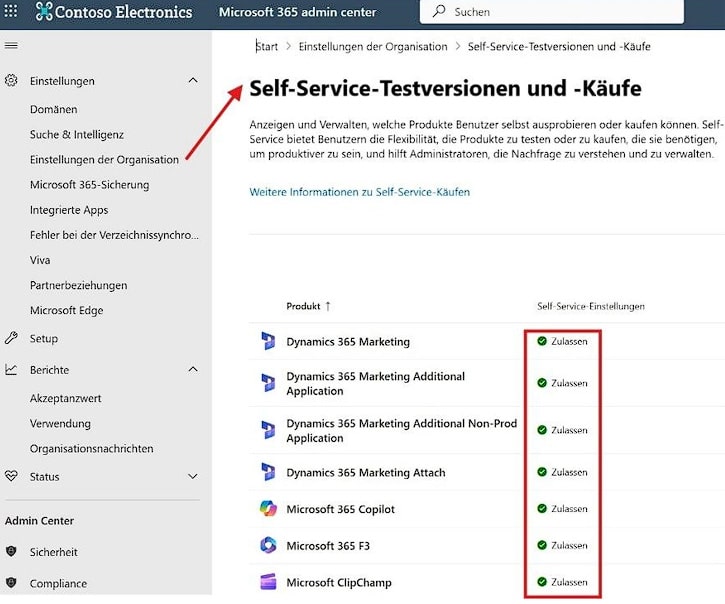

Self-Service-Tests & Käufe

Unter Self-Service-Testversionen und -Käufe legen wir fest, ob User eigenständig Trial-Lizenzen oder Add-ins beziehen können. Stell hier am besten alles auf „Nicht zulassen“. So ermöglicht Ihr eine zentrale Bereitstellung von Services durch die IT.

Beispiel: Teams Exploratory

Lässt du Self-Service offen, tauchen schnell Sachen wie der Teams Exploratory Plan unter Abrechnung → Ihre Produkte auf. Dies macht uns deutlich, wie häufig schon Dienste inkl. Lizenzen freigegeben wurden. Besser wäre: Self-Service vorher dichtmachen und einen klaren Prozess für neue Apps und Lizenzen festlegen.

Unterm Strich gilt: Schalte Pseudonymisierung ein, damit Report-Daten datenschutzkonform bleiben, sperre Self-Service-Käufe, damit dir keine wilden Trial-Lizenzen durchs Netz rutschen, und regle bei Bedarf Ausnahmen. So behältst du Kontrolle bei der Auswertung von Daten und der Bereitstellung von Services.

Versionierung und Speichernutzung

Pfad: admin.sharepoint.com → Einstellungen → Grenzen des Versionsverlaufs

Hier können wir festlegen, wie viele Versionen gespeichert werden und wie lange.

Standardmäßig wird empfohlen, die Option auf Automatisch zu setzen – der Speicher wird dabei durch einen intelligenten Algorithmus optimiert.

Die Option Manuell ist auf 500 Versionen ohne Ablaufdatum gesetzt. Diese Einstellung kann in vielen Fällen überdimensioniert sein – insbesondere bei größeren Dateien wie PowerPoint-Präsentationen oder Projektarchiven.

Empfehlung: Setzen Sie die maximale Anzahl an Versionen manuell auf 100 und definieren Sie gleichzeitig ein Ablaufdatum– etwa nach sechs Monaten oder einem Jahr. Auch benutzerdefinierte Werte sind möglich.

Da jede Änderung einer 100-MB-PowerPoint eine neue Version erzeugt und so bei 500 Versionen schnell 50 GB belegen – besonders, wenn mehrere Nutzer parallel arbeiten –, sollten wir die voreingestellten 500 Versionen ohne Ablaufdatum empfehlenswerterweise herabsetzen.

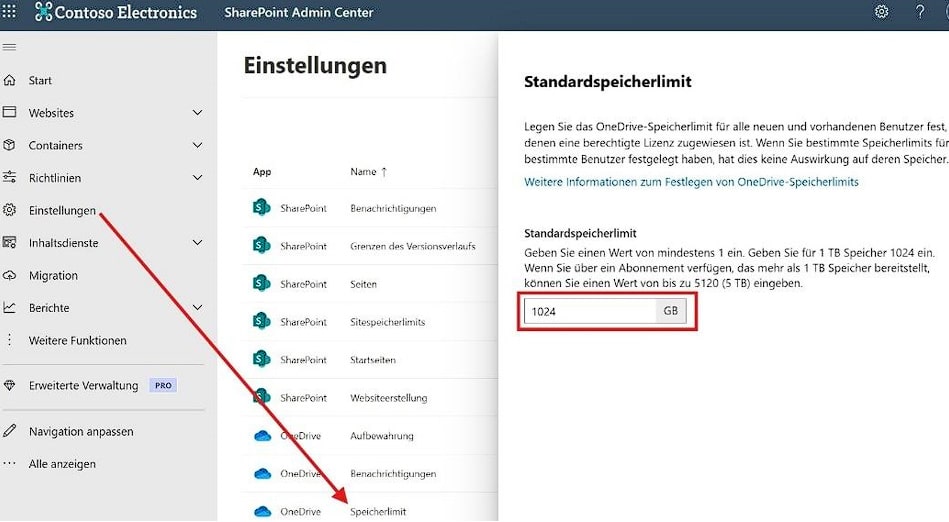

OneDrive Speicherlimit definieren

Pfad: admin.sharepoint.com → Einstellungen → Speicherlimit

Der Standardwert liegt bei 1024 MB, der Mindestwert bei 1 TB. Ab dem fünften lizenzierten Benutzer stellt Microsoft bis zu 5 TB pro Benutzer zur Verfügung. Hier stellt sich jedoch die Frage: Ist das tatsächlich notwendig? In vielen Fällen reichen deutlich kleinere Speicherbereiche aus. Es empfiehlt sich auch hier mal zu evaluieren (z.B.: über die Berichte im Microsoft 365 Admincenter), wie stark die Nutzung von OneDrive in unseren Unternehmen aktuell ist.

Tipp: Wir sollten genau überlegen, wie viel Speicher wir zur Verfügung stellen wollen – denn jede zusätzliche Kapazität bringt Verwaltungs- und Sicherheitsaufwand mit sich. Zugriffe müssen überwacht, Daten klassifiziert und entsprechend verarbeitet werden.

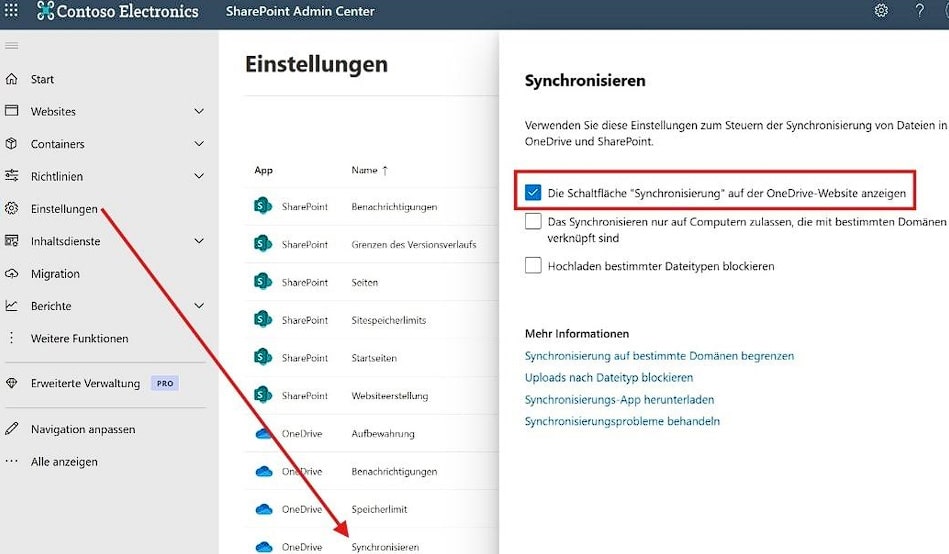

Zugriffsvalidierung und OneDrive-Synchronisation

Die folgenden Einstellungen betreffen weniger Copilot direkt, sondern vielmehr die Validierung von Zugriffen und den Schutz unserer Daten.

Pfad: admin.sharepoint.com → Einstellungen → OneDrive Synchronisieren

Die zentrale Frage lautet: Wollen wir es zulassen, dass Benutzer über den Web-Zugriff auch Daten herunterladen dürfen? Entscheidend ist dabei, ob der Zugriff technisch auf verwaltete Unternehmensgeräte beschränkt ist. Hier würde wieder die Anwendung von Conditional Access eine entscheidene Rolle spielen.

Wenn das nicht der Fall ist, kann es sinnvoll sein, die Synchronisierungsfunktion zunächst zu deaktivieren – und schrittweise wieder zu aktivieren, sobald klar ist, wie die Zugriffssituation geregelt ist.

Diese Einschränkung scheint auf den ersten Blick sehr restriktiv, sorgt jedoch für mehr Kontrolle und reduziert das Risiko unkontrollierter Datenflüsse.

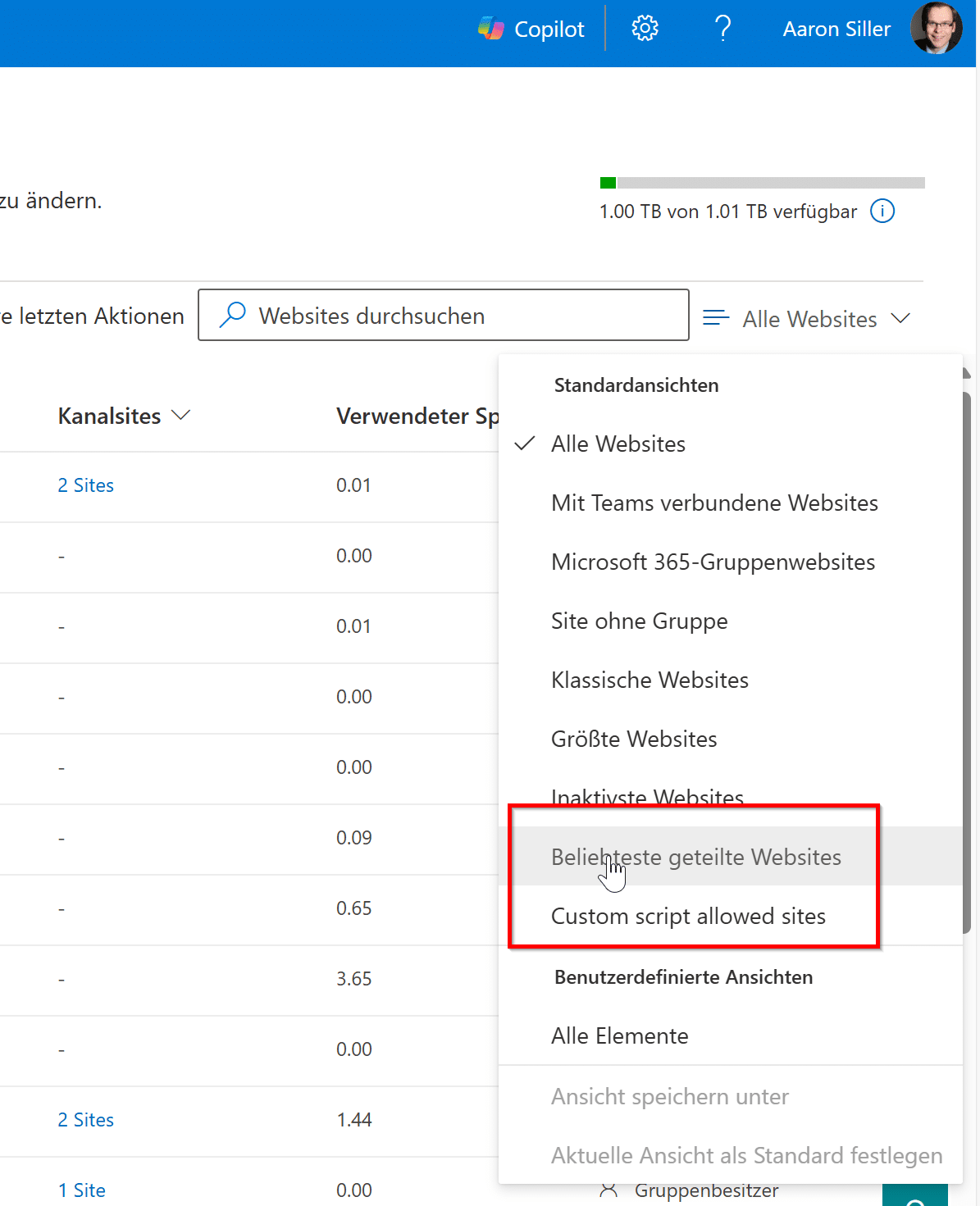

Die Erweiterte Verwaltung im SharePoint

Pfad: admin.sharepoint.com → Erweiterte Verwaltung

Wir verwenden SharePoint Advanced Management (somit die "Erweiterte Verwaltung") um den Zugriff auf Inhalte zu steuern, übermäßiges Teilen zu verhindern und den Lebenszyklus von Inhalten zu verwalten. Zudem benötigen wir die Implementierung einer eingeschränkten SharePoint-Suche, um die Auffindbarkeit sensibler Inhalte zu begrenzen

Empfehlung: Ich empfehle, diese Lizenz für dein Unternehmen zu erwerben - sobald Du eine Microsoft 365 Copilot Lizenz besitzt, werden Dir diese Funktionen ebenfalls zur Verfügung stehen. Ohne diese Funktion lassen sich bestimmte Richtlinien nicht umsetzen, die für eine saubere und konforme Copilot-Einführung erforderlich sind.

Wer Reports, Richtlinien und weiterführende Konfigurationen für Copilot plant, wird auf diese Funktion nicht verzichten wollen und auch können. Sie wird zum zentralen Bestandteil einer sicheren, steuerbaren Umgebung.

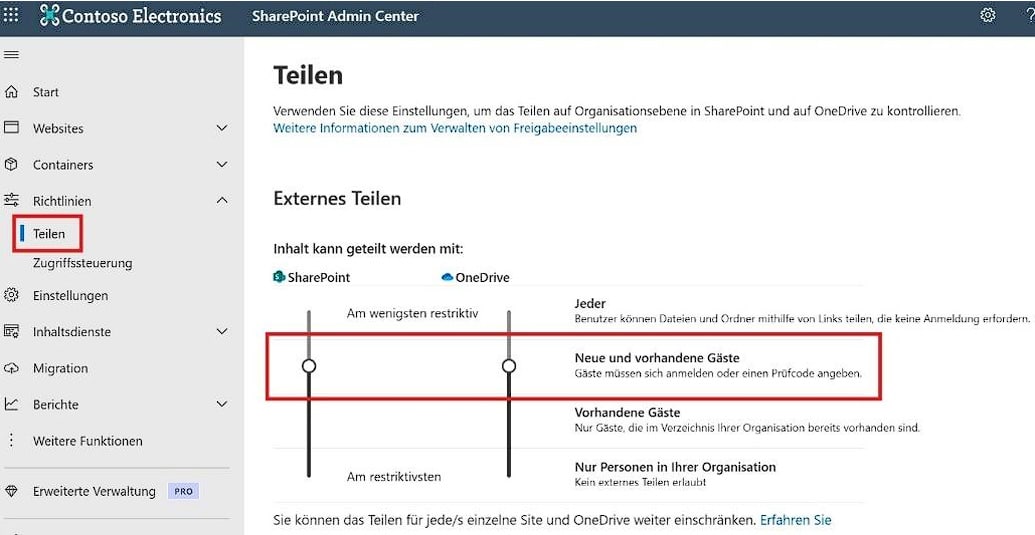

Anpassungen zum Thema 'Externes Teilen'

Pfad: admin.sharepoint.com → Richtlinien → Teilen

Die bekannten Optionen wie Jeder, Neue und vorhandene Gäste, Vorhandene Gäste und Nur Personen in Ihrer Organisation sind Teil der erweiterten Ansicht, die wir u.a. in den Organisationseinstellungen einsehen können.

Hier können wir zudem im SharePoint den Zugriff herunterregeln, der dann automatisch für OneDrive angepasst wird. OneDrive kann nicht höher eingestuft werden als SharePoint – das wird systemseitig abgelehnt.

Es empfiehlt sich wirklich sehr, nicht ein Teilen über die Funktion "Jeder" bereitzustellen, um die Nutzung von anonymen Links beim Teilen von Dokumenten und Inhalten zu verhindern.

Denn denken wir daran: Copilot analysiert die in SharePoint und OneDrive gespeicherten Daten, sowie freigegeben Inhalte, um darauf aufbauend Antworten zu genieren. Deswegen ist es so wichtig, dass wir übermäßiges Teilen von Inhalten verhindern und Zugriffe kontrollieren.

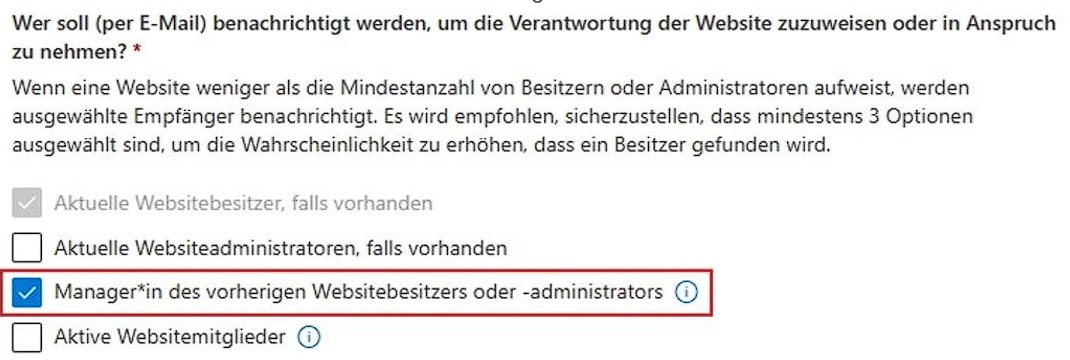

Site Ownership Policies und Berichtserstellung

Die ersten beiden Schritte unterscheiden sich nicht von der Berichterstellung für Inactive Sites. Im dritten Schritt jedoch, können wir nun festlegen, wer informiert werden soll: Owner oder Admin.

Wenn Du mit Microsoft 365 Copilot arbeitest, brauchst Du eine saubere Datenbasis und klar definierte Verantwortlichkeiten. Genau hier kommen die Site Ownership Policies ins Spiel. Sie helfen Dir dabei, Ordnung in Deine SharePoint-Seiten, Microsoft Teams und Microsoft 365 Gruppen zu bringen – und sichern den Betrieb langfristig ab.

Standardmäßig ist die Site Ownership Policy auf den Wert 2 (Recommended) gesetzt – und genau das solltest Du auch übernehmen. Denn ein zweiter Owner bedeutet Redundanz: Wenn jemand das Unternehmen verlässt oder einfach mal nicht erreichbar ist, bleibt die Seite trotzdem betreubar. Zugriffsentscheidungen können weiterhin getroffen, Berechtigungen angepasst und Inhalte verwaltet werden. In der Praxis übernehmen Owner eine Art Gatekeeper-Rolle – als Data Stewards oder Data Guards stellen sie sicher, dass niemand zu viel oder zu wenig Zugriff hat.

So setzt Du Site Ownership Policies sinnvoll ein

Bevor Du in die Konfiguration einsteigst, solltest Du zunächst eine Bestandsaufnahme machen: Welche Inhalte sind aktiv, wer nutzt welche Seiten, und wo gibt es verwaiste oder unklare Zuständigkeiten? Erst danach geht es an die Owner-Struktur. Prüfe in allen Microsoft Teams, Gruppen und SharePoint-Sites, wie viele Owner hinterlegt sind – und ergänze konsequent einen zweiten.

Im nächsten Schritt legst Du fest, wer benachrichtigt werden soll, wenn sich etwas ändert oder Maßnahmen nötig sind. Du kannst sogar definieren, welche Aktion bei Inaktivität greifen soll – z. B. den automatischen Wechsel in den Schreibschutzmodus. Das schützt Deine Umgebung vor unkontrolliertem Zugriff und sorgt dafür, dass nur gepflegte Daten für Copilot & Co. zur Verfügung stehen.

Nur mit klaren Zuständigkeiten und aktiven Eigentümern lässt sich das Potenzial von Copilot wirklich sicher und verantwortungsvoll ausschöpfen.

Stell sicher, dass jede Site, jedes Team und jede M365-Gruppe mindestens zwei Owner hat und setz die Benachrichtigungs-Option im dritten Schritt der Site-Ownership-Policy auf Wert 2 (Owner). So bleibt die Verwaltung handlungsfähig, falls jemand ausfällt, und alle Zugriffsanfragen landen direkt bei den Verantwortlichen statt beim Admin-Postfach.

Bei den Site-Ownership-Policies legst du nach der üblichen Bestands- und Inaktivitätsprüfung fest, wer Änderungen mitkriegt und welche Aktion (z. B. Schreibschutz) greift. Owners fungieren dabei als Data Stewards, kontrollieren Zugriffe und halten die Inhalte sauber. Prüfe daher deine aktuelle Owner-Verteilung und ergänze überall einen zweiten Owner, bevor du die automatischen Benachrichtigungen und Maßnahmen aktivierst.

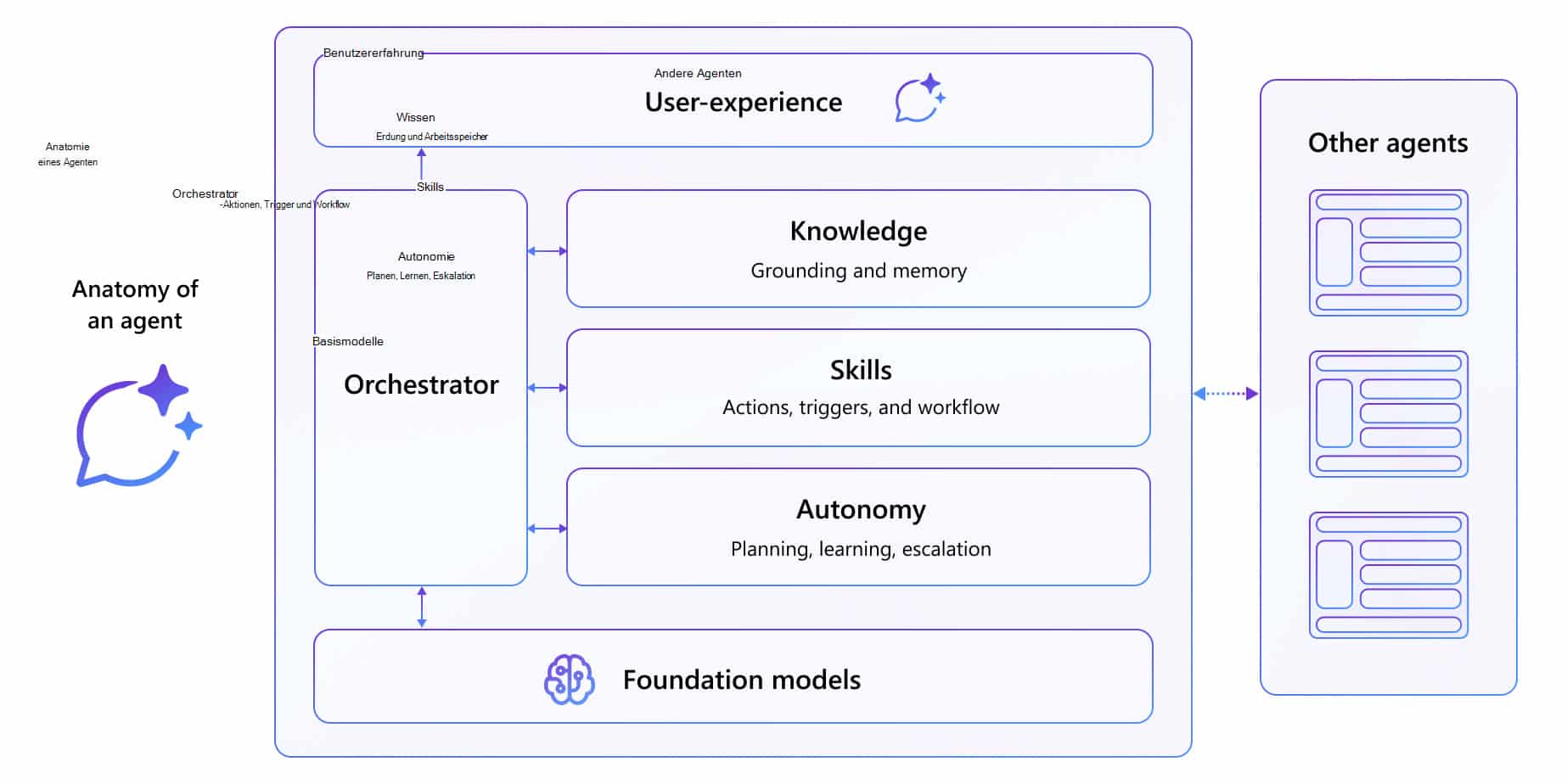

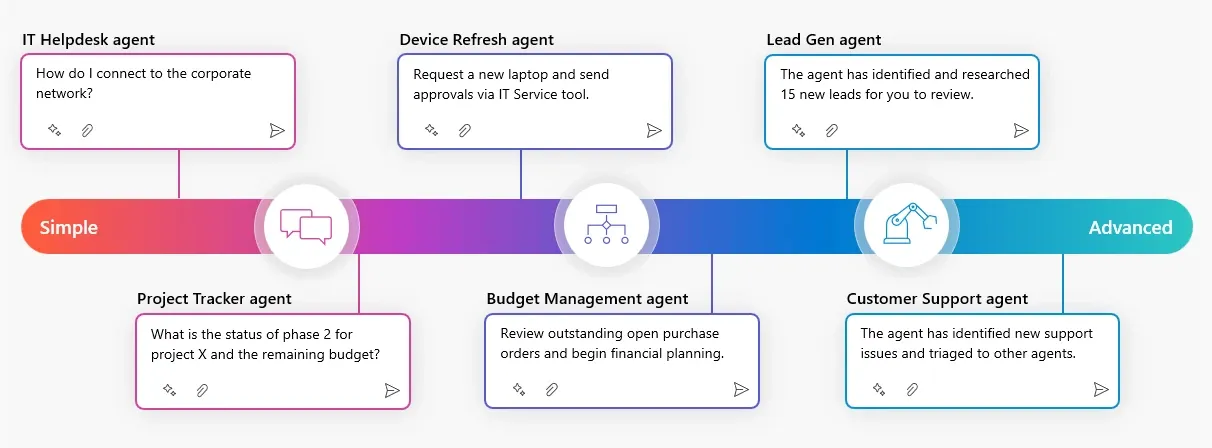

Microsoft 365 Copilot und die Arbeit mit Agents

Mit der Einführung von Microsoft 365 Copilot hat Microsoft nicht nur generative KI in den Arbeitsalltag integriert, sondern auch eine neue Klasse von Automatisierung geschaffen: Copilot Agents. Diese Agents sind vorkonfigurierte oder benutzerdefinierte KI-Helfer, die eigenständig Aufgaben ausführen, Entscheidungen treffen oder proaktiv Informationen liefern – basierend auf den Regeln und Daten, die Du ihnen vorgibst.

Für Admins bedeutet das: Du musst dafür sorgen, dass nur freigegebene, strukturierte und zugriffsberechtigte Inhalte für die Agents verfügbar sind. Ohne saubere Datenquellen, präzise Berechtigungen und klar definierte Regeln riskierst Du Fehlinformationen oder Datenlecks. Daher beginnt die Bereitstellung immer mit einem technischen und organisatorischen Fundament.

Bereitstellung von Copilot Agents: So richtest Du sie technisch ein

Die Einrichtung von Copilot Agents beginnt im Copilot Studio, ehemals bekannt als Power Virtual Agents. Dort hast Du die Möglichkeit, entweder einen bestehenden Agent anzupassen oder einen komplett neuen zu erstellen. Wichtig ist dabei: Agents agieren kontextbezogen – das bedeutet, Du musst ihnen genau sagen, worauf sie zugreifen dürfen und was sie tun sollen. Die folgenden Schritte sind entscheidend für eine erfolgreiche Bereitstellung:

Zugriff auf Copilot Studio aktivieren

Stelle sicher, dass betroffene Benutzer oder Admins über die notwendigen Lizenzen (z. B. Copilot Studio oder Microsoft 365 Copilot) verfügen und Copilot Studio im Tenant aktiviert ist.Neuen Agent erstellen oder Vorlage verwenden

Im Copilot Studio kannst Du eine leere Vorlage starten oder auf branchenspezifische Szenarien zurückgreifen (z. B. HR, IT-Support). Dabei bestimmst Du:Name und Beschreibung des Agents

Zielgruppe (z. B. nur bestimmte Teams oder Abteilungen)

Sprache und Antwortverhalten

Datenquellen und Konnektoren anbinden

Über Microsoft Graph, SharePoint Online, Dataverse, Exchange oder eigene APIs kannst Du genau definieren, woher der Agent seine Informationen bezieht. Nutze hier bevorzugt:Graph-Konnektoren für Microsoft 365-Inhalte

Power Platform-Konnektoren für Dynamics, SQL, SAP etc.

Eigene REST-APIs, falls interne Systeme angebunden werden sollen

Themen, Trigger und Flows definieren

Richte sogenannte Topics (Themenbereiche) ein, auf die der Agent reagieren soll – z. B. „Wie beantrage ich Urlaub?“ oder „Wo finde ich meine Lohnabrechnung?“. Du kannst auch Power Automate Flows hinterlegen, damit der Agent z. B. Tickets automatisch erstellt oder Daten ausliest.Sicherheit und Zugriff regeln

Lege per RBAC und Dataverse Security Roles fest, wer den Agent verwenden oder verwalten darf. Zusätzlich kannst Du Conditional Access nutzen, um die Verwendung auf bestimmte Netzwerke oder Geräte einzuschränken.Veröffentlichen und Testen

Sobald der Agent fertig ist, veröffentlichst Du ihn und testest das Verhalten – zunächst im internen Preview-Modus, bevor Du ihn produktiv freigibst. Über die integrierten Analysetools kannst Du die Nutzung, Fragen und Antwortqualität überwachen.

Antworten auf häufig gestellte Fragen zu Microsoft 365 Copilot

Ein KI-Assistent, der in Microsoft 365 integriert ist und deine Arbeit mit Word, Excel, Teams & Co. durch automatische Textgenerierung, Zusammenfassungen und Datenanalysen unterstützt.

Ja, du brauchst eine Microsoft 365 E3/E5 oder Business Standard/Premium Lizenz plus die Copilot Add-on-Lizenz für 30$/Monat pro Nutzer.

In deutschen Rechenzentren (Frankfurt/Berlin), aber bei hoher Auslastung kann die Verarbeitung auch in andere europäische Rechenzentren ausweichen.

Copilot sieht nur das, worauf du auch Zugriff hast - basierend auf deinen SharePoint-, OneDrive- und Teams-Berechtigungen. Keine Hexerei, nur deine bestehenden Rechte.

Übermäßige Freigaben ("Jeder"-Links), fehlende Datenklassifizierung und unstrukturierte Berechtigungen können dazu führen, dass Copilot ungewollt sensible Infos anzeigt.

Nutze Sensitivity Labels, aktiviere Conditional Access, schränke SharePoint-Freigaben ein und implementiere die Restricted SharePoint Search für maximal 100 Seiten.

Das sind Funktionen, die Internetinhalte abrufen oder deine Daten analysieren. Ohne sie funktioniert Copilot in Office-Apps nicht - also bloß nicht deaktivieren!

Technisch ja, aber aus Sicherheitsgründen solltest du das über Conditional Access einschränken und nur verwaltete Firmengeräte zulassen.

Eine Art Landkarte deiner Firmendaten, die Copilot nutzt, um Zusammenhänge zu verstehen. Wird alle 8 Stunden aktualisiert (0, 8, 16, 24 Uhr UTC).

Bis zu 8 Stunden, da der Index nur dreimal täglich synchronisiert wird. Also Geduld haben!

KI-Assistenten für spezielle Aufgaben wie Helpdesk oder Changemanagement, die du mit Copilot Studio (Low-Code) selbst erstellen kannst.

Ja, über config.office.com kannst du verhindern, dass Copilot Bing-Suchergebnisse einbezieht - dann nutzt er nur interne Firmendaten.

Setze Aufbewahrungsrichtlinien, lösche inaktive SharePoint-Seiten und nutze das Site Lifecycle Management für automatische Bereinigung.

Das ist eine separate Lizenz, die für erweiterte Governance-Features wie Site Access Reviews und Restricted Search benötigt wird - Preise variieren.

Ja, definitiv! Copilot kann Nutzeraktivitäten nachverfolgen (Audit Logs), daher solltest du Datenschutz und Mitbestimmung frühzeitig einbeziehen.